Laura Ibáñez

ZEUS

23 SEPT 2023

Laura Ibáñez es graduada en Ingeniería Electrónica (UPC) y en Música (ESMUC). Actualmente cursa un Máster de Investigación en Inteligencia Artificial (UNED) y se especializa en el uso de técnicas de Deep Learning para aplicaciones de generación musical. Ha trabajado durante dos años en la startup Pixtunes como ingeniera de Machine Learning para aplicaciones musicales y en el presente trabaja como freelance para la empresa AudioShake, especializada en la separación de fuentes musicales mediante inteligencia artificial.

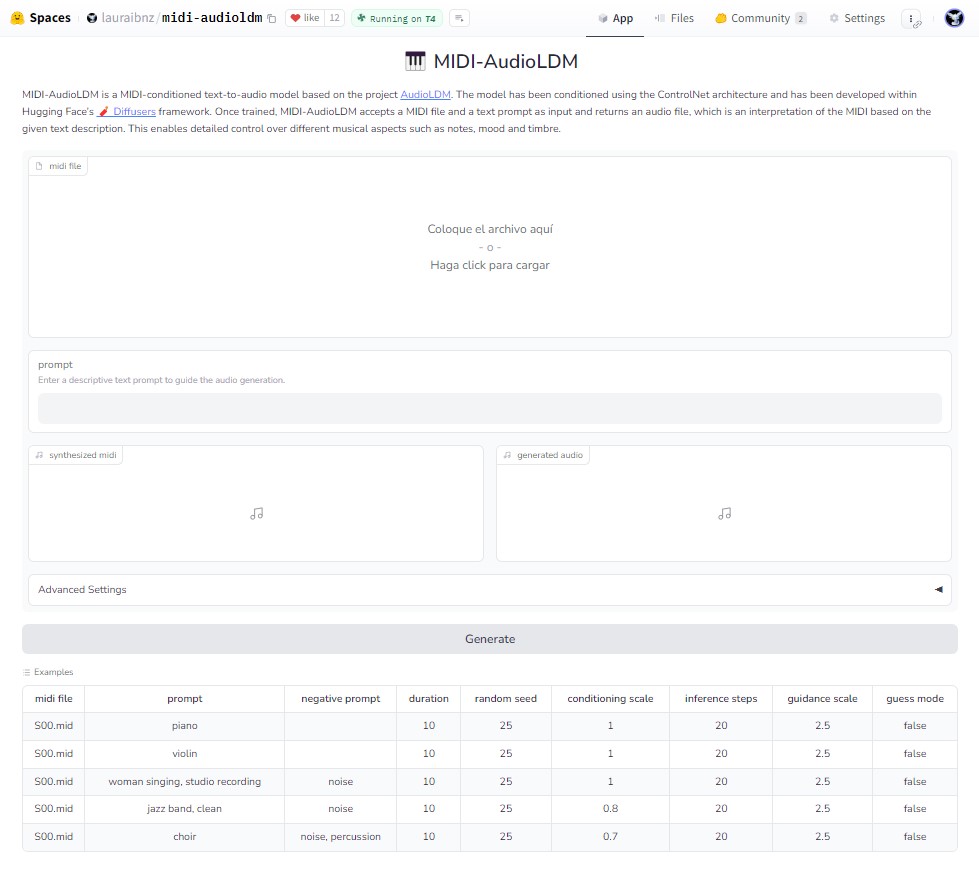

Laura Ibáñez describirá el estado del arte de los modelos de texto-a-audio para la generación musical, que aparecen tras el gran éxito de modelos de texto-a-imagen como DALL·E o Stable Diffusion. Presentará el proyecto MIDI-AudioLDM, desarrollado como trabajo final del Máster de Investigación en Inteligencia Artificial de la UNED. MIDI-AudioLDM es un modelo de texto-a-audio condicionado por MIDI basado en el proyecto AudioLDM y desarrollado dentro de la librería Diffusers de Hugging Face.

Finalmente se hará un pequeño workshop en el que se sugerirán diferentes cuadernos de Google Colab y espacios de Hugging Face para probar estos modelos.

huggingface.co/spaces/lauraibnz/midi-audioldm